ChatGPT : des avocats affirment que l’IA les a amenés à citer une fausse jurisprudence

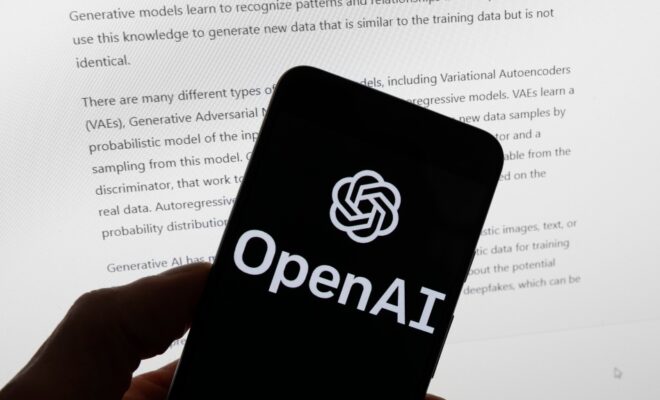

Deux avocats apologétiques répondant à un juge en colère du tribunal fédéral de Manhattan ont accusé ChatGPT jeudi de les avoir incités à inclure des recherches juridiques fictives dans un dossier judiciaire.

Les avocats Steven A. Schwartz et Peter LoDuca risquent d’être punis pour avoir déposé une plainte contre une compagnie aérienne qui comprenait des références à des affaires judiciaires passées que Schwartz pensait être réelles, mais qui ont en fait été inventées par le chatbot alimenté par l’intelligence artificielle.

Schwartz a expliqué qu’il avait utilisé le programme révolutionnaire alors qu’il recherchait des précédents juridiques soutenant le dossier d’un client contre la compagnie aérienne colombienne Avianca pour une blessure subie lors d’un vol en 2019.

Le chatbot, qui a fasciné le monde avec sa production de réponses de type essai aux invites des utilisateurs, a suggéré plusieurs cas impliquant des accidents d’aviation que Schwartz n’avait pas été en mesure de trouver par les méthodes habituelles utilisées dans son cabinet d’avocats.

Le problème était que plusieurs de ces cas n’étaient pas réels ou impliquaient des compagnies aériennes qui n’existaient pas.

Schwartz a déclaré au juge de district américain P. Kevin Castel qu’il « opérait selon une idée fausse … que ce site Web obtenait ces cas d’une source à laquelle je n’avais pas accès ».

Il a dit qu’il avait « lamentablement échoué » à faire des recherches de suivi pour s’assurer que les citations étaient correctes.

« Je n’avais pas compris que ChatGPT pouvait fabriquer des cas », a déclaré Schwartz.

Microsoft a investi environ 1 milliard de dollars dans OpenAI, la société derrière ChatGPT.

Son succès, démontrant comment l’intelligence artificielle pourrait changer la façon dont les humains travaillent et apprennent, a suscité des craintes chez certains. Des centaines de chefs de file de l’industrie ont signé une lettre en mai qui avertit que « l’atténuation du risque d’extinction de l’IA devrait être une priorité mondiale aux côtés d’autres risques à l’échelle de la société tels que les pandémies et la guerre nucléaire ».

Le juge Castel a semblé à la fois déconcerté et troublé par cet événement inhabituel et déçu que les avocats n’aient pas agi rapidement pour corriger les fausses citations juridiques lorsqu’ils ont été alertés pour la première fois du problème par les avocats d’Avianca et le tribunal. Avianca a souligné la fausse jurisprudence dans un dossier de mars.

Le juge a confronté Schwartz à une affaire judiciaire inventée par le programme informatique. Il a été initialement décrit comme une affaire de mort injustifiée intentée par une femme contre une compagnie aérienne pour se transformer en une action en justice concernant un homme qui a raté un vol pour New York et a été contraint d’engager des dépenses supplémentaires.

« Pouvons-nous convenir que c’est du charabia juridique? » demande Castel.

Schwartz a déclaré qu’il pensait à tort que la présentation déroutante résultait d’extraits tirés de différentes parties de l’affaire.

Lorsque Castel a terminé son interrogatoire, il a demandé à Schwartz s’il avait autre chose à dire.

« Je voudrais sincèrement m’excuser », a déclaré Schwartz.

Il a ajouté qu’il avait souffert personnellement et professionnellement à la suite de la bévue et qu’il se sentait « gêné, humilié et extrêmement plein de remords ».

Il a déclaré que lui et l’entreprise où il travaillait – Levidow, Levidow & Oberman – avaient mis en place des garanties pour s’assurer que rien de semblable ne se reproduise.

LoDuca, un autre avocat qui a travaillé sur l’affaire, a déclaré qu’il faisait confiance à Schwartz et qu’il n’avait pas suffisamment examiné ce qu’il avait compilé.

Après que le juge ait lu à haute voix des extraits d’un cas cité pour montrer à quel point il était facile de discerner qu’il s’agissait de « charabia », a déclaré LoDuca : « Il ne m’est jamais venu à l’esprit qu’il s’agissait d’un faux cas. »

Il a dit que le résultat « me fait mal sans fin ».

Ronald Minkoff, un avocat du cabinet d’avocats, a déclaré au juge que la soumission « résultait d’une négligence et non d’une mauvaise foi » et ne devrait pas entraîner de sanctions.

Il a déclaré que les avocats ont toujours eu du mal avec la technologie, en particulier les nouvelles technologies, « et cela ne devient pas plus facile ».

« M. Schwartz, quelqu’un qui fait à peine de la recherche fédérale, a choisi d’utiliser cette nouvelle technologie. Il pensait qu’il avait affaire à un moteur de recherche standard », a déclaré Minkoff. « Ce qu’il faisait, c’était jouer avec des munitions réelles. »

Daniel Shin, professeur auxiliaire et directeur adjoint de la recherche au Center for Legal and Court Technology de la William & Mary Law School, a déclaré qu’il avait présenté l’affaire Avianca lors d’une conférence la semaine dernière qui a attiré des dizaines de participants en personne et en ligne de l’État et du gouvernement fédéral. tribunaux aux États-Unis, y compris le tribunal fédéral de Manhattan.

Il a déclaré que le sujet avait provoqué un choc et une confusion lors de la conférence.

« Nous parlons du district sud de New York, le district fédéral qui gère les grosses affaires, du 11 septembre à tous les grands crimes financiers », a déclaré Shin. « Il s’agissait du premier cas documenté de faute professionnelle potentielle par un avocat utilisant l’IA générative. »

Il a déclaré que l’affaire montrait que les avocats n’avaient peut-être pas compris le fonctionnement de ChatGPT, car il avait tendance à halluciner, à parler de choses fictives d’une manière qui semblait réaliste mais qui ne l’était pas.

« Cela met en évidence les dangers de l’utilisation de technologies d’IA prometteuses sans en connaître les risques », a déclaré Shin.

Le juge a déclaré qu’il statuerait sur les sanctions à une date ultérieure.