Le harcèlement, une préoccupation croissante dans la réalité virtuelle

Si vous en croyez Mark Zuckerberg, le futur est virtuel.

L’année dernière, Meta a investi 10 milliards de dollars dans Facebook Reality Labs, la partie de l’entreprise qui développe des gadgets et des logiciels de réalité virtuelle et augmentée. La division est chargée de donner vie à la vision du fondateur de Facebook d’un monde où la réalité virtuelle et la réalité augmentée changent tout, de l’épicerie aux sorties entre amis.

Zuckerberg est allé jusqu’à changer le nom de l’entreprise de Facebook à Meta l’année dernière – une décision reflétant sa concentration sur la construction d’un soi-disant métaverse, qui est un concept de science-fiction qui envisage, essentiellement, une version immersive d’Internet. Et Meta a déclaré qu’il avait l’intention d’investir encore plus que ces 10 milliards de dollars américains au cours des prochaines années.

En tant que l’un des grands gagnants du Web 2.0 – avec des ressources massives et des milliards d’utilisateurs – Meta est particulièrement bien placé pour façonner ce qui va suivre sur Internet. Et il s’efforce de garder sa vision métaverse au premier plan : Zuckerberg a déclaré la semaine dernière que la société déploierait une version de bureau de son application phare de réalité virtuelle sociale, Horizon Worlds, plus tard cette année afin que les gens puissent en faire l’expérience sans casque (la société a également parlé d’une version mobile de l’application). Il a ajouté qu’à l’avenir, vous serez incarné par votre avatar Meta – la version caricaturale et personnalisable de vous-même utilisée pour naviguer dans l’application – dès que vous mettez votre casque, « prêt à interagir dans Horizon avec vos amis ».

Avec ce passage au métaverse, l’entreprise doit voir un nouveau départ à partir des erreurs du passé, comme le scandale de Cambridge Analytica et la désinformation rampante qui sévit sur Facebook. Mais il y a déjà un problème que certains utilisateurs ont signalé dans l’espace naissant : le harcèlement et d’autres comportements indésirables, en particulier dans les applications et les jeux de réalité virtuelle sociale, y compris dans Horizon Worlds. Les incidents récemment signalés incluent des commentaires odieux et racistes jaillis par les avatars d’autres personnes, ainsi que des tâtonnements et des baisers.

Le harcèlement a une longue histoire dans les espaces numériques, mais le support littéralement en face de la réalité virtuelle peut le rendre beaucoup plus réel que sur un écran plat. Et les entreprises à l’origine de plusieurs des applications de réalité virtuelle les plus populaires ne veulent pas en parler : Meta, ainsi que les applications sociales de réalité virtuelle populaires VRChat et Rec Room, ont refusé les demandes d’interview de CNN Business sur la manière dont ils combattent le harcèlement en réalité virtuelle.

Mais le problème va certainement devenir plus courant car des casques moins chers et plus puissants incitent un nombre croissant de personnes à débourser pour la technologie : vous pouvez actuellement acheter le Quest 2 pour 299 $, ce qui le rend moins cher (et plus facile à trouver) que une PlayStation 5 de Sony.

« Je pense [harassment] est un problème que nous devons prendre au sérieux dans la réalité virtuelle, surtout si nous voulons que ce soit un espace en ligne accueillant, un espace en ligne diversifié », a déclaré Daniel Castro, vice-président de l’Information Technology & Innovation Foundation. « Même si vous voyez vraiment mal comportement se produit dans le monde réel, je pense que cela peut s’aggraver en ligne. »

BULLES, BLOCS ET MUETS

La réalité virtuelle n’est pas devenue accessible aux masses du jour au lendemain : pour Meta, cela a commencé avec l’achat d’Oculus VR par la société en 2014, et dans les années qui ont suivi, la société a déployé une série de casques de plus en plus performants, abordables et portables. Ce travail porte ses fruits, car les casques Meta’s Quest représentaient environ 80% des casques VR expédiés l’année dernière, selon Jitesh Ubrani, directeur de recherche chez IDC, chercheur sur le marché des technologies.

Et à mesure que de plus en plus de personnes passent du temps en réalité virtuelle, les mauvais comportements qui peuvent survenir sont de plus en plus mis en évidence. Il est difficile de dire à quel point le harcèlement VR est répandu, mais un rapport de décembre du Center for Countering Digital Hate à but non lucratif donne une idée de sa prévalence dans VRChat. Là, les chercheurs ont identifié 100 violations potentielles des politiques VR de Meta, y compris le harcèlement et les abus sexuels, pendant 11 heures et 30 minutes passées à enregistrer l’activité des utilisateurs. (Alors que VRChat a refusé une interview, Charles Tupper, le responsable de la communauté de VRChat, a fourni des détails par e-mail sur ses outils de sécurité et a déclaré que la société comptait régulièrement plus de 80 000 personnes utilisant VRChat – la majorité d’entre elles avec des casques VR – pendant les heures de pointe le week-end. )

Dans l’espoir d’arrêter et de prévenir les mauvais comportements, les applications de réalité virtuelle sociale ont tendance à offrir un certain nombre d’outils communs que les gens peuvent utiliser. Ces outils vont de la possibilité de créer une bulle invisible d’espace personnel autour de vous pour empêcher d’autres avatars de s’approcher trop près de vous, de mettre en sourdine les personnes que vous ne voulez pas entendre, de les bloquer entièrement afin qu’elles ne puissent pas voir ou vous entendre et vice versa.

Signaler un mauvais comportement et les pratiques de modération en place dans la réalité virtuelle peuvent être similaires à celles des jeux en ligne. Les utilisateurs peuvent parfois voter pour expulser quelqu’un d’un espace VR – j’en ai fait l’expérience récemment lorsqu’on m’a demandé de voter sur l’opportunité d’expulser une personne de la place de Meta’s Horizon Worlds après qu’ils m’ont approché à plusieurs reprises, ainsi que d’autres utilisateurs, en disant: « Par le façon, je suis célibataire. » (Cet utilisateur a obtenu le démarrage.) Les modérateurs humains sont également utilisés pour répondre aux plaintes de mauvais comportement, et les applications peuvent suspendre ou interdire les utilisateurs si leur comportement est suffisamment flagrant.

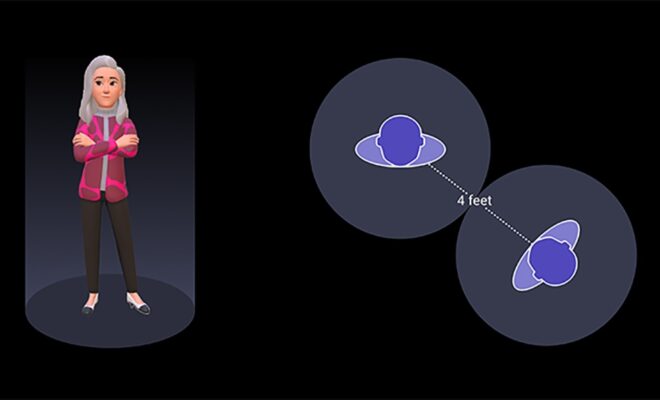

Horizon Worlds, VRChat et Rec Room offrent tous ce type de fonctionnalités de sécurité. Horizon Worlds a ajouté sa propre zone tampon par défaut de quatre pieds autour des avatars des utilisateurs en février, environ trois mois après le lancement de l’application. VRChat et Rec Room, qui existent depuis des années, démarrent également les utilisateurs avec une zone tampon par défaut.

« Ces étapes sont dans la bonne direction », a déclaré Castro, bien qu’il reconnaisse que différentes applications et plates-formes – ainsi que des espaces publics de réalité virtuelle où tout le monde peut s’arrêter, par opposition à des espaces privés où les invitations sont limitées – viendront avec différents défis de modération de contenu.

Ces outils évolueront également avec le temps, à mesure que de plus en plus de personnes utilisent la réalité virtuelle. Dans un communiqué, Bill Stillwell, chef de produit pour l’intégrité VR chez Meta, a déclaré : « Nous continuerons à apporter des améliorations à mesure que nous en apprendrons davantage sur la façon dont les gens interagissent dans ces espaces. »

UN FARDEAU POUR LES VICTIMES

Bien que certains des outils actuels puissent être utilisés de manière proactive, beaucoup d’entre eux ne sont utiles qu’après avoir déjà été harcelé, a souligné Guo Freeman, professeur adjoint d’informatique centrée sur l’humain à l’Université de Clemson qui étudie les jeux et la réalité virtuelle sociale. À cause de cela, elle a le sentiment qu’ils mettent un fardeau sur les victimes.

Un effort pour faciliter la détection et le signalement du harcèlement vient d’une société appelée Modulate. Son logiciel, connu sous le nom de ToxMod, utilise l’intelligence artificielle pour surveiller et analyser ce que les utilisateurs disent, puis prédit quand quelqu’un débite un langage harcelant ou raciste, par exemple, et ne se contente pas de se livrer à des propos injurieux. ToxMod peut alors alerter un modérateur humain ou, dans certains cas, désactiver automatiquement les utilisateurs fautifs. Rec Room l’essaie dans certains des espaces publics de l’application VR.

Il est logique que les fabricants d’applications soient aux prises avec les défis de modération qui accompagnent la mise à l’échelle et se demandent si de nouveaux types d’automatisation pourraient aider : le marché de la réalité virtuelle est encore minuscule par rapport à celui des jeux vidéo sur console, mais il se développe rapidement. IDC estime que près de 11 millions de casques VR ont été expédiés en 2021, soit un bond de 96 % par rapport aux 5,6 millions expédiés un an auparavant, a déclaré Ubrani. Au cours des deux années, les casques Meta’s Quest ont constitué la majorité de ces expéditions.

À certains égards, ToxMod est similaire au nombre d’entreprises de médias sociaux qui modèrent déjà leurs plates-formes, avec une combinaison d’humains et d’IA. Mais le sentiment de présence aiguë que les utilisateurs ont tendance à ressentir en VR – et le fait qu’il repose si fortement sur la communication parlée plutôt qu’écrite – pourrait donner à certaines personnes l’impression d’être espionnées. (Modulate a déclaré que les utilisateurs sont avertis lorsqu’ils entrent dans un espace virtuel où ToxMod peut être utilisé, et lorsqu’une nouvelle application ou un nouveau jeu commence à utiliser ToxMod, le gestionnaire de communauté de Modulate communiquera généralement avec les utilisateurs en ligne – par exemple via le canal Discord d’un jeu – pour répondre des questions sur son fonctionnement.)

« C’est certainement quelque chose auquel nous passons beaucoup de temps à réfléchir », a déclaré le PDG de Modulate, Mike Pappas.

IL N’Y A PAS DE NORMES ÉTABLIES

Un défi primordial dans la lutte contre le harcèlement en réalité virtuelle est le manque d’accord sur ce qui compte même comme du harcèlement dans un espace virtuel par rapport à un espace physique. En partie, c’est parce que même si la réalité virtuelle elle-même n’est pas nouvelle – elle existe sous différentes incarnations depuis des décennies – elle est nouvelle en tant que média de masse, et elle change tout le temps en conséquence.

Cette nouveauté signifie qu’il n’y a pas de normes établies, ce qui peut rendre difficile pour quiconque derrière un casque de déterminer ce qui va ou ne va pas lorsqu’il interagit avec d’autres personnes en réalité virtuelle. Un nombre croissant d’enfants entrent également dans des espaces virtuels et, comme l’a souligné Freeman, ce qu’un enfant peut considérer comme jouer (comme courir et agir sauvagement) un adulte peut le considérer comme du harcèlement.

« Souvent, dans nos recherches, les participants se sentent très confus quant à savoir s’il s’agit ou non d’un comportement ludique ou de harcèlement », a déclaré Freeman.

Le harcèlement en réalité virtuelle peut également prendre de nouvelles formes que les gens ne peuvent pas avoir hors ligne. Kelly Guillory, illustratrice de bandes dessinées et rédactrice en chef d’un magazine en ligne sur la réalité virtuelle, a vécu cette expérience l’année dernière après avoir bloqué un ancien ami dans VRChat qui avait commencé à agir en contrôlant et à avoir des explosions émotionnelles.

Une fois qu’elle l’a bloqué, elle ne pouvait plus le voir ni l’entendre dans VRChat. Mais Guillory était, étrangement, toujours capable de percevoir sa présence à proximité. À plusieurs reprises, alors qu’elle discutait avec des amis sur l’application, l’avatar de son harceleur s’approchait du groupe. Elle pense qu’il soupçonnait que son avatar était là, car ses amis prononçaient souvent son nom à haute voix. Il se joignait à la conversation, parlant aux autres personnes avec lesquelles elle interagissait. Mais comme Guillory ne pouvait ni voir ni entendre son avatar, il semblait que ses amis avaient une conversation à sens unique. Pour Guillory, c’était comme si son harceleur tentait de contourner son blocage et de lui imposer sa présence virtuelle.

« Les deux premières fois, c’est arrivé, c’était ennuyeux », a-t-elle déclaré. « Mais ensuite, ça a continué à arriver. »

ÇA PEUT SE SENTIR RÉEL

De telles expériences en réalité virtuelle peuvent sembler extrêmement réelles. Freeman a déclaré que dans ses recherches, les gens ont rapporté que le fait d’avoir leur avatar attrapé par l’avatar d’une autre personne semblait réaliste, surtout s’ils utilisaient un suivi complet du corps pour reproduire les mouvements de leurs membres. Une femme a rapporté qu’un autre utilisateur de réalité virtuelle s’approchait de son visage, ayant l’air de l’avoir embrassée – une action qui lui faisait peur, a-t-elle dit à Freeman, car cela ressemblait à quelqu’un faisant la même chose dans le monde hors ligne.

« Parce que c’est immersif, la caractéristique incarnée de la réalité virtuelle sociale, ces comportements semblent en quelque sorte réalistes, ce qui signifie qu’ils peuvent sembler dommageables parce qu’ils sont physiques, la menace », a déclaré Freeman.

C’était le cas pour Guillory: elle a développé de l’anxiété à ce sujet et a perdu confiance dans les gens en ligne, a-t-elle déclaré. Elle a finalement parlé sur Twitter du harcèlement, ce qui a aidé.

« J’aime toujours ça ici, mais je veux que les gens fassent mieux », a-t-elle déclaré.